Next: 2.3 Erweiterung auf Heterostrukturen

Up: 2. Schrödinger-Poisson-Solver

Previous: 2.1 Schrödinger-Gleichung

Unterabschnitte

Abbildung 2.3:

Symbolbild einer MOS-Struktur und Festlegung der Lage der

Koordinatenachsen.

|

|

Die bisherigen Ableitungen wenden wir nun auf den Fall eines

MOS-Transistors an. Abbildung 2.3 zeigt eine

schematische Skizze einer solchen Struktur und die Lage des gewählten

Koordinatensystems. Für die hier vorgesehene Untersuchung ist

lediglich das zwischen Drain und Source gelegene Gebiet unter dem Gate

von Interesse. Durch Oxidation wird eine dünne Oxidschicht direkt auf

dem Siliziumsubstrat erzeugt und somit eine Isolierung zwischen dem

Kanal und dem zur Ladungssteuerung verwendeten Gatekontakt

hergestellt. Über die Gatespannung kann dann unter der Oxidschicht

durch das resultierende Feld die Ladungsträgerdichte verändert, und so

der Strom vom Source- zum Drain-Kontakt beeinflusst werden

([31]). Meist wird die Oxidschicht nicht direkt mit dem

Metall kontaktiert, sondern eine zusätzliche, hochdotierte

Polysiliziumschicht als Gate verwendet. Für den Transport der

Ladungsträger von Source zu Drain wird die Quantisierung quer zum

Kanal betrachtet und diese Richtung als z-Koordinate festgelegt. In

den beiden verbleibenden Raumrichtungen wird das Elektron als frei

beweglich angesehen, man spricht in diesem Fall von einem

zweidimensionalen Elektronengas.

Abbildung 2.4:

Isoenergieflächen der Elektronen in den sechs

Valenzbändern in Silizium und deren Projektion

![\includegraphics[]{Theorie/AnisotropieBW}](img240.png)

|

Die Annahme einer isotropen Masse in (2.2)

diente nur zur einfachen Beschreibung der Nichtparabolizität. Bei den

derzeit üblichen Herstellungsverfahren verwendet man hauptsächlich

Siliziumkristalle mit

Oberflächen. Bei Silizium

liegen die Leitungsbandminima in den X-Tälern symmetrisch zu den

Achsen, die durch den

Oberflächen. Bei Silizium

liegen die Leitungsbandminima in den X-Tälern symmetrisch zu den

Achsen, die durch den  und die sechs

und die sechs  Punkte der

Brillouin-Zone aufgespannt werden. Die Flächen konstanter Energie sind

Ellipsoide, die durch zwei unterschiedliche Massen, die longitudinale

Masse

Punkte der

Brillouin-Zone aufgespannt werden. Die Flächen konstanter Energie sind

Ellipsoide, die durch zwei unterschiedliche Massen, die longitudinale

Masse

und die transversale Masse

und die transversale Masse

, bestimmt sind.

, bestimmt sind.

|

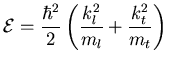

(2.33) |

Abbildung 2.4 skizziert diese sechs Ellipsoide

entlang der Hauptachsen des Wellenvektorraums.

In der Folge werden wir die Quantisierung nur in der Normalrichtung zur

Grenzfläche zwischen Oxid und Halbleiter

betrachten. Aus der Projektion der Ellipsoide auf diese Oberfläche

erkennt man bereits die später verwendete Unterteilung in einzelne

Talsorten.

Tabelle 2.2:

Aufstellung der effektiven Massen in den einzelnen Talsorten.

| |

|

|

|

Entartung |

| Talsorte 1 |

|

|

|

2 |

| Talsorte 2 |

|

|

|

2 |

| Talsorte 3 |

|

|

|

2 |

|

In Tabelle 2.2 sind die in den verschiedenen

Talsorten verwendeten Massen angegeben.

In Hinblick auf die zu verwendende Quantisierungsmasse

sind die vier äußeren Ellipsoide, hier als Talsorte 2 und 3 angeführt,

als äquivalent anzusehen. Die

beiden auf einen Kreis projizierten Ellipsoide werden zur Talsorte 1

zusammengefasst.

Um alle Leitungsbandminima bei der Behandlung der

Quantisierung zu berücksichtigen, werden nur zwei verschiedene

Talsorten behandelt, diese aber mit einem Entartungsfaktor

sind die vier äußeren Ellipsoide, hier als Talsorte 2 und 3 angeführt,

als äquivalent anzusehen. Die

beiden auf einen Kreis projizierten Ellipsoide werden zur Talsorte 1

zusammengefasst.

Um alle Leitungsbandminima bei der Behandlung der

Quantisierung zu berücksichtigen, werden nur zwei verschiedene

Talsorten behandelt, diese aber mit einem Entartungsfaktor

gewichtet, der die Anzahl der zur Talsorte

gewichtet, der die Anzahl der zur Talsorte  zusammengefassten Täler

angibt.

zusammengefassten Täler

angibt.

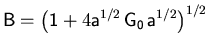

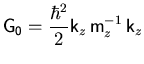

Im hier vorliegenden Fall örtlich konstanter Massen und

Nichtparabolizitätskoeffizienten können die Operatoren

bis

bis

explizit angegeben werden.

explizit angegeben werden.

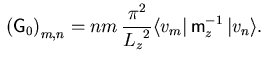

Tabelle 2.3:

Zusammenfassung der Eigenwerte der

voneinander abhängigen Operatoren im Falle des

MOS-Transistors.

| |

Die in Tabelle 2.3 angegebenen Operatoren haben

für eine konstante Masse

und einen konstanten

Nichtparabolizitätskoeffizienten

und einen konstanten

Nichtparabolizitätskoeffizienten

dieselben Eigenfunktionen, da sie jeweils in Form einer Potenzreihe

mit einem der anderen Operatoren dargestellt werden können. Der

Zusammenhang zwischen den Operatoren

dieselben Eigenfunktionen, da sie jeweils in Form einer Potenzreihe

mit einem der anderen Operatoren dargestellt werden können. Der

Zusammenhang zwischen den Operatoren

und

und

ist

für den Separationsansatz (2.4)

in (2.7) angegeben. Analog zur

Transformation (2.14) wurde der

Oparator

ist

für den Separationsansatz (2.4)

in (2.7) angegeben. Analog zur

Transformation (2.14) wurde der

Oparator

definiert. Die Spektraldarstellung

des Operators

definiert. Die Spektraldarstellung

des Operators

lautet nach (2.20):

lautet nach (2.20):

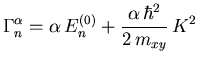

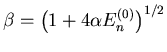

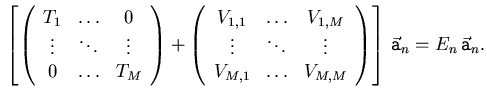

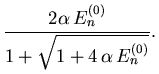

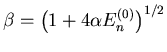

Die darin vorkommenden Eigenwerte werden in eine Potenzreihe

nach  entwickelt und Terme bis zur Ordnung vier

berücksichtigt. Der Eigenwert des Operators

entwickelt und Terme bis zur Ordnung vier

berücksichtigt. Der Eigenwert des Operators

lautet

lautet

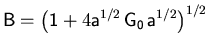

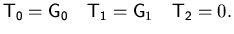

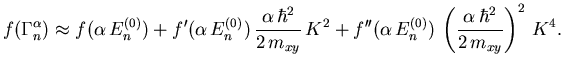

|

(2.34) |

und wir erhalten somit die Entwicklung

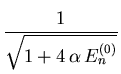

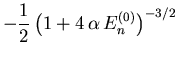

Die Ableitungen der Funktion (2.17) ergeben sich dabei zu

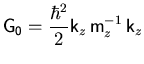

Unter Verwendung der Abkürzung

|

(2.35) |

ergibt sich schließlich folgende Spektraldarstellung des Operators der

kinetischen Energie.

|

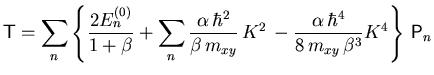

(2.36) |

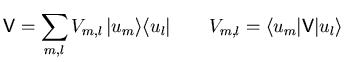

Mit dem Operator

|

(2.37) |

ergeben sich dann die in (2.22) verwendeten

Operatoren wie folgt.

Betrachten wir noch den Spezialfall eines verschwindenden

Nichtparabolizitätskoeffizienten im nicht quantisierten Fall, so ergibt sich

|

(2.39) |

In allen Subbändern ergibt sich dann als Subbandmasse

die

effektive Elektronenmasse.

die

effektive Elektronenmasse.

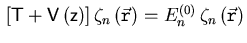

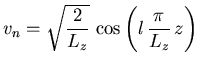

Für die Lösung der eindimensionalen Schrödinger-Gleichung

|

(2.40) |

in einem Simulator benötigen wir die in (2.40)

verwendeten Operatoren

,

,

,

,

,

,

,

,

,

,

in einer

Matrizendarstellung in der gewählten Basis

in einer

Matrizendarstellung in der gewählten Basis  .

Aus der für das Basissystem gültigen

Vollständigkeitsrelation (2.19) ergibt

sich die Darstellung des gesuchten Zustandsvektors

.

Aus der für das Basissystem gültigen

Vollständigkeitsrelation (2.19) ergibt

sich die Darstellung des gesuchten Zustandsvektors

in dieser Basis.

in dieser Basis.

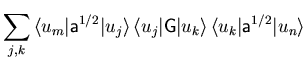

Die Matrixdarstellung des Operators der potenziellen Energie lautet:

|

(2.42) |

Produkte von Operatoren können als Produkt dieser Matrizen

angeschrieben werden. Als Beispiel sei hier das Matrixelement des

Operators

angegeben.

angegeben.

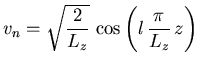

Eine Sonderstellung nimmt der Operator

|

(2.46) |

ein. In diesem kommt der Operator

vor.

Bei der gewählten Basis, in der Sinusfunktionen verwendet werden,

ergibt sich aus der Anwendung des Operators

vor.

Bei der gewählten Basis, in der Sinusfunktionen verwendet werden,

ergibt sich aus der Anwendung des Operators

das Matrixelement

des Operators

das Matrixelement

des Operators

wie folgt.

wie folgt.

|

(2.47) |

Für die Berechnung dieser Matrixelemente sind die Basisfunktionen

nicht ausreichend. Die Anwendung des Operators

nicht ausreichend. Die Anwendung des Operators

auf die Basisfunktionen

auf die Basisfunktionen  führt in eine neue Basis

bestehend aus Kosinusfunktionen. Durch zweimalige Anwendung des

Operators

führt in eine neue Basis

bestehend aus Kosinusfunktionen. Durch zweimalige Anwendung des

Operators

gelangt man jedoch wieder in die ursprüngliche

Basis. Verwendet man also die neuen Funktionen

gelangt man jedoch wieder in die ursprüngliche

Basis. Verwendet man also die neuen Funktionen

|

(2.48) |

für die Berechnung der Matrixelemente des Operators

und berücksichtigt die Vorfaktoren die sich aus der Ableitung der

Basisfunktionen

und berücksichtigt die Vorfaktoren die sich aus der Ableitung der

Basisfunktionen  ergeben, wie

in (2.49) angegeben, können auch die

Matrixelemente von

ergeben, wie

in (2.49) angegeben, können auch die

Matrixelemente von

in der Basis

in der Basis  angegeben

werden.

angegeben

werden.

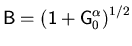

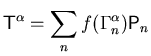

Bei der Darstellung des Operators

ist eine

Operatorfunktion

ist eine

Operatorfunktion

|

(2.49) |

auszuwerten. Dies erfolgt in der Matrixdarstellung

von

durch Transformation der in der Diagonale

vorkommenden Eigenwerte.

durch Transformation der in der Diagonale

vorkommenden Eigenwerte.

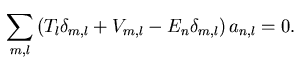

Die Darstellung der Schrödinger-Gleichung (2.42)

in Matrixdarstellung lautet somit:

|

(2.50) |

Die Summation in (2.52) erstreckt sich über den

unendlich-dimensionalen Hilbert-Raum. Mit einem numerischen Verfahren

wird eine Näherungslösung in einem endlich dimensionalen Unterraum

gesucht. In der auf eine Anzahl von  Funktionen beschränkten Basis

lautet dann die Matrixeigenwertgleichung

zu (2.52):

Funktionen beschränkten Basis

lautet dann die Matrixeigenwertgleichung

zu (2.52):

|

(2.51) |

Die Koeffizienten der endlich dimensionalen Darstellung der Wellenfunktion

sind dabei zum Vektor

sind dabei zum Vektor

zusammengefasst worden.

Im Vergleich mit Lösungsansätzen die die Nichtparabolizität außer Acht

lassen, handelt es sich hier wegen der Matrixelemente der potenziellen

Energie um ein Matrixeigenwertproblem mit

vollbesetzter Matrix, welches mit Standardroutinen aus dem Algebrapacket

LAPACK gelöst werden kann ([9]).

zusammengefasst worden.

Im Vergleich mit Lösungsansätzen die die Nichtparabolizität außer Acht

lassen, handelt es sich hier wegen der Matrixelemente der potenziellen

Energie um ein Matrixeigenwertproblem mit

vollbesetzter Matrix, welches mit Standardroutinen aus dem Algebrapacket

LAPACK gelöst werden kann ([9]).

Für die Implementierung in einer objektorientierten Sprache wurde eine

eigene Klasse für Matrixelemente entworfen. Um Operatorfunktionen

auszuwerten, wird jeweils auf eine Diagonalform transformiert, es

werden also die Eigenwerte berechnet. Die Anwendung einer

Operatorfunktion ist dann leicht durchzuführen. Um sowohl

Speicherplatz als auch Rechenaufwand zu minimieren, werden drei

Spezialfälle unterschieden. Erstens werden Matrixelemente eines

Skalars wie zum Beispiel einer räumlich konstanten Masse als skalarer

Wert behandelt. Zweitens liegen viele Matrizen bereits in

Diagonalform vor und brauchen nicht diagonalisiert werden. Nur im

allgemeinsten Fall ist die Berechnung der Eigenwerte und

Eigenfunktionen der Matrix erforderlich.

Bei der Initialisierung des Simulators werden die Matrixelemente der

Operatoren

und

und

mit Hilfe dieser Klasse

berechnet. Ausgangspunkt sind dabei die Matrixelemente der bekannten

Operatoren wie Masse, Nichtparabolizitätskoeffizient und

mit Hilfe dieser Klasse

berechnet. Ausgangspunkt sind dabei die Matrixelemente der bekannten

Operatoren wie Masse, Nichtparabolizitätskoeffizient und

. Bei den

Umformungen ist dabei der Wechsel zwischen den beiden Basisfunktionen

(Kosinus und Sinus) zu beachten, der es ermöglicht den Operator

. Bei den

Umformungen ist dabei der Wechsel zwischen den beiden Basisfunktionen

(Kosinus und Sinus) zu beachten, der es ermöglicht den Operator

in Matrizenform zu behandeln. Bei der Lösung der

Schrödinger-Gleichung für ein anderes Potenzial können die

Matrixelemente des Operators der kinetischen Energie wieder verwendet

werden.

in Matrizenform zu behandeln. Bei der Lösung der

Schrödinger-Gleichung für ein anderes Potenzial können die

Matrixelemente des Operators der kinetischen Energie wieder verwendet

werden.

Für die Simulation muss weiters neben der Wahl einer passenden

Ausdehnung

des Simulationsgebietes auch die Anzahl der

verwendeten Basisfunktionen auf eine endliche Zahl reduziert

werden. Zweitere Beschränkung muss einerseits eine ausreichende

Genauigkeit beziehungsweise örtliche Auflösung garantieren,

andererseits aber die Anforderungen an Speicherplatz und vor allem

Rechenzeit in realistischen Grenzen halten. Die Anforderungen bei der

Wahl von

des Simulationsgebietes auch die Anzahl der

verwendeten Basisfunktionen auf eine endliche Zahl reduziert

werden. Zweitere Beschränkung muss einerseits eine ausreichende

Genauigkeit beziehungsweise örtliche Auflösung garantieren,

andererseits aber die Anforderungen an Speicherplatz und vor allem

Rechenzeit in realistischen Grenzen halten. Die Anforderungen bei der

Wahl von

sind ähnlich geschichtet. Der Wert muss groß genug

gewählt sein, um bei den zu erwartenden Potenzialverhältnissen ein

realistisches Abklingen der Wellenfunktionen zu

ermöglichen. Gleichzeitig garantiert allerdings wegen der Wahl einer

endlichen Anzahl an Basisfunktionen nur ein möglichst kleiner Wert von

sind ähnlich geschichtet. Der Wert muss groß genug

gewählt sein, um bei den zu erwartenden Potenzialverhältnissen ein

realistisches Abklingen der Wellenfunktionen zu

ermöglichen. Gleichzeitig garantiert allerdings wegen der Wahl einer

endlichen Anzahl an Basisfunktionen nur ein möglichst kleiner Wert von

die korrekte Darstellung örtlich rasch oszillierender

Wellenfunktionen an der Grenze zum Oxid.

die korrekte Darstellung örtlich rasch oszillierender

Wellenfunktionen an der Grenze zum Oxid.

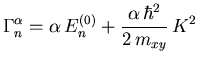

Abbildung 2.5:

Vergleich der parabolischen, polynomialen und punktweise

berechneten Energiedispersionsrelation für einige Subbänder.

|

|

In Abbildung 2.5 sind die

Dispersionsrelationen im ersten, fünften und zehnten Subband

dargestellt. Zuerst sind die durch (2.29)

eingeführten Dispersionsrelationen mit den Subbandmassen und

Nichtparabolizitätskoeffizienten aus (2.31)

und (2.32) dargestellt. Der Verlauf der sich aus

der bei Termen vierter Ordnung abgebrochenen Polynomdarstellung

nach (2.28) ergibt ist ebenfalls gezeigt.

Deutlich zu erkennen ist der problematische Verlauf dieser

polynomialen Approximation. Bei steigender Wellenzahl ergeben sich

negative Energiewerte. Zwar hat auch die nichtparabolische

Dispersionsrelation in diesem Bereich keine physikalische

Berechtigung, die Energie bleibt jedoch positiv definit. Bei

Berechnungen der Elektronendichte wird für große Werte des

Wellenvektors der Beitrag durch die dann rasch abklingende

Verteilungsfunktion verschwinden. Beim Berechnen der Matrix

in (2.53) ist für einen bestimmten Wert des

Parallel-Wellenvektors  die Störung

die Störung

in der Spektraldarstellung des Operators der kinetischen

Energie (2.20) nur eine Konstante. Diese Störung

kann bei der Berechnung der Matrixelemente inkludiert werden und liefert

eine punktweise berechnete Dispersionsrelation, wie sie in

Abbildung 2.5 eingezeichnet wurde.

in der Spektraldarstellung des Operators der kinetischen

Energie (2.20) nur eine Konstante. Diese Störung

kann bei der Berechnung der Matrixelemente inkludiert werden und liefert

eine punktweise berechnete Dispersionsrelation, wie sie in

Abbildung 2.5 eingezeichnet wurde.

Next: 2.3 Erweiterung auf Heterostrukturen

Up: 2. Schrödinger-Poisson-Solver

Previous: 2.1 Schrödinger-Gleichung

C. Troger: Modellierung von Quantisierungseffekten in Feldeffekttransistoren

![\includegraphics[]{Schroedinger/MOS-fin.eps}](img239.png)

![\includegraphics[]{Theorie/AnisotropieBW}](img240.png)

![]() angegeben.

angegeben.

![]() ist eine

Operatorfunktion

ist eine

Operatorfunktion

![]() und

und

![]() mit Hilfe dieser Klasse

berechnet. Ausgangspunkt sind dabei die Matrixelemente der bekannten

Operatoren wie Masse, Nichtparabolizitätskoeffizient und

mit Hilfe dieser Klasse

berechnet. Ausgangspunkt sind dabei die Matrixelemente der bekannten

Operatoren wie Masse, Nichtparabolizitätskoeffizient und

![]() . Bei den

Umformungen ist dabei der Wechsel zwischen den beiden Basisfunktionen

(Kosinus und Sinus) zu beachten, der es ermöglicht den Operator

. Bei den

Umformungen ist dabei der Wechsel zwischen den beiden Basisfunktionen

(Kosinus und Sinus) zu beachten, der es ermöglicht den Operator

![]() in Matrizenform zu behandeln. Bei der Lösung der

Schrödinger-Gleichung für ein anderes Potenzial können die

Matrixelemente des Operators der kinetischen Energie wieder verwendet

werden.

in Matrizenform zu behandeln. Bei der Lösung der

Schrödinger-Gleichung für ein anderes Potenzial können die

Matrixelemente des Operators der kinetischen Energie wieder verwendet

werden.

![]() des Simulationsgebietes auch die Anzahl der

verwendeten Basisfunktionen auf eine endliche Zahl reduziert

werden. Zweitere Beschränkung muss einerseits eine ausreichende

Genauigkeit beziehungsweise örtliche Auflösung garantieren,

andererseits aber die Anforderungen an Speicherplatz und vor allem

Rechenzeit in realistischen Grenzen halten. Die Anforderungen bei der

Wahl von

des Simulationsgebietes auch die Anzahl der

verwendeten Basisfunktionen auf eine endliche Zahl reduziert

werden. Zweitere Beschränkung muss einerseits eine ausreichende

Genauigkeit beziehungsweise örtliche Auflösung garantieren,

andererseits aber die Anforderungen an Speicherplatz und vor allem

Rechenzeit in realistischen Grenzen halten. Die Anforderungen bei der

Wahl von

![]() sind ähnlich geschichtet. Der Wert muss groß genug

gewählt sein, um bei den zu erwartenden Potenzialverhältnissen ein

realistisches Abklingen der Wellenfunktionen zu

ermöglichen. Gleichzeitig garantiert allerdings wegen der Wahl einer

endlichen Anzahl an Basisfunktionen nur ein möglichst kleiner Wert von

sind ähnlich geschichtet. Der Wert muss groß genug

gewählt sein, um bei den zu erwartenden Potenzialverhältnissen ein

realistisches Abklingen der Wellenfunktionen zu

ermöglichen. Gleichzeitig garantiert allerdings wegen der Wahl einer

endlichen Anzahl an Basisfunktionen nur ein möglichst kleiner Wert von

![]() die korrekte Darstellung örtlich rasch oszillierender

Wellenfunktionen an der Grenze zum Oxid.

die korrekte Darstellung örtlich rasch oszillierender

Wellenfunktionen an der Grenze zum Oxid.

![\includegraphics[]{Schroedinger/energy-fin.eps}](img300.png)

![]() die Störung

die Störung

![]() in der Spektraldarstellung des Operators der kinetischen

Energie (2.20) nur eine Konstante. Diese Störung

kann bei der Berechnung der Matrixelemente inkludiert werden und liefert

eine punktweise berechnete Dispersionsrelation, wie sie in

Abbildung 2.5 eingezeichnet wurde.

in der Spektraldarstellung des Operators der kinetischen

Energie (2.20) nur eine Konstante. Diese Störung

kann bei der Berechnung der Matrixelemente inkludiert werden und liefert

eine punktweise berechnete Dispersionsrelation, wie sie in

Abbildung 2.5 eingezeichnet wurde.